OpenClaw veröffentlicht neue Data-Pipeline-Architektur

OpenClaw Blueprint stellt umfassende Architektur für die Verarbeitung von Rohdaten zu strukturiertem Wissen vor

OpenClaw Blueprint veröffentlicht Data-Pipeline-Architektur

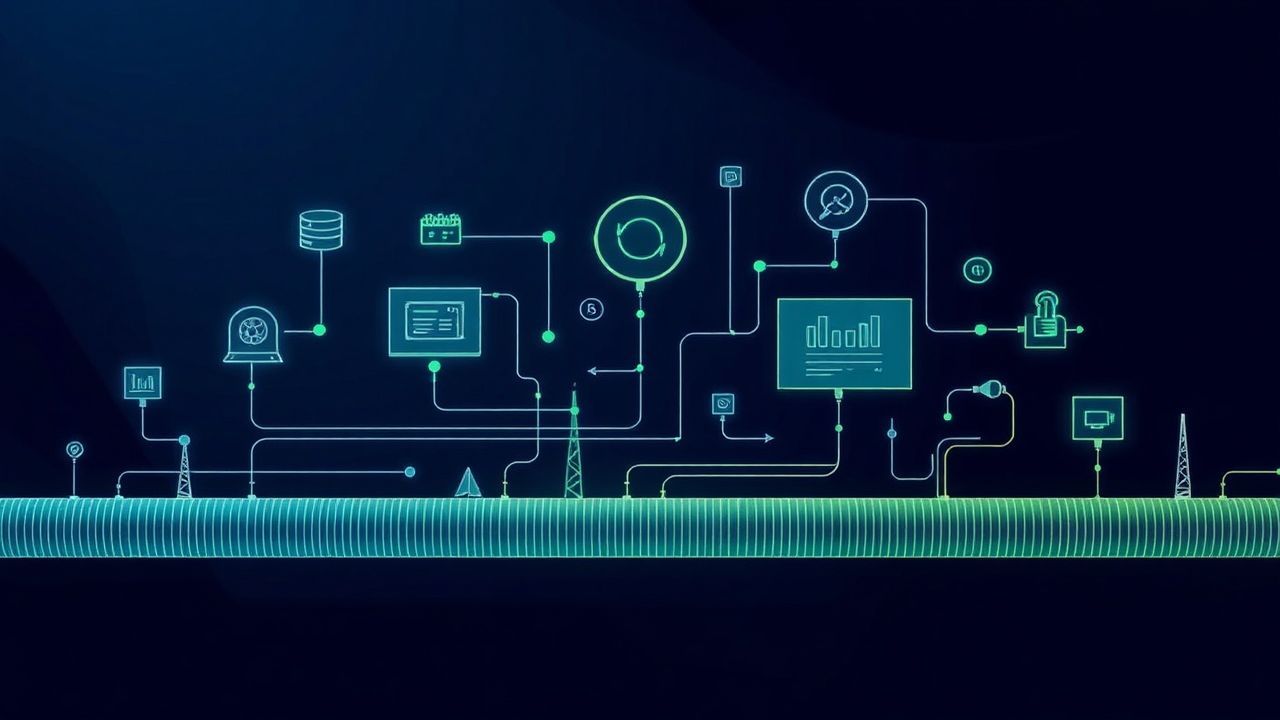

Die OpenClaw-Community hat am 16. März 2026 eine umfassende Dokumentation zur Data-Pipeline-Architektur veröffentlicht. Der Blogbeitrag auf theopenclawblueprint.com beschreibt detailliert, wie Rohdaten systematisch in strukturiertes Wissen überführt werden können.

Architektur im Überblick

Die Architektur folgt einem modularen Ansatz mit klar definierten Komponenten für Datenerfassung, -verarbeitung und -speicherung. Besonders hervorgehoben werden die Skalierbarkeit und die Integration in bestehende DevOps-Pipelines.

Zielgruppen und Anwendungsfälle

Die Lösung richtet sich primär an Entwicklerteams und DevOps-Engineers, die robuste Datenverarbeitungssysteme aufbauen möchten. Anwendungsbereiche umfassen Machine Learning-Pipelines, Echtzeitanalysen und Data Lakes.

Technische Details

Die Dokumentation enthält konkrete Implementierungsbeispiele und Best Practices für die Einrichtung der Pipeline. Dabei wird auf gängige Open-Source-Tools und Cloud-native Ansätze gesetzt.

Community-Feedback

Bereits kurz nach Veröffentlichung hat die Ankündigung auf Twitter positive Resonanz gefunden. Die Community diskutiert die Praxistauglichkeit und mögliche Erweiterungen der Architektur.

Zukünftige Entwicklungen

OpenClaw plant, die Architektur kontinuierlich weiterzuentwickeln und an neue Anforderungen anzupassen. Geplant sind zusätzliche Module für spezialisierte Anwendungsfälle und erweiterte Überwachungsfunktionen.